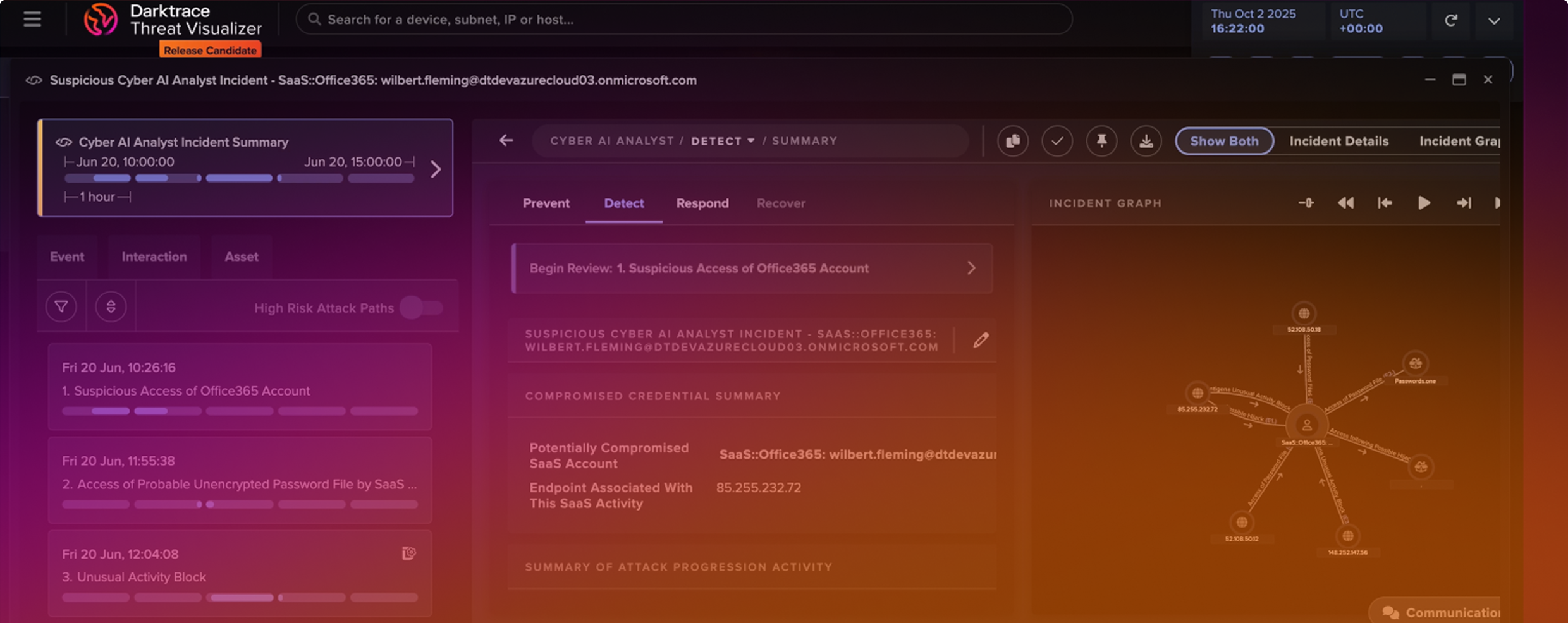

AIについての知識は2024年と比較して大きく向上しています。2024年の調査では、回答者の26%は生成AIについてぼんやりとしか知らない、あるいは聞いたことがないと述べていました。今ではほとんどの回答者がサイバーセキュリティスタックにおいて生成AIを利用しています。

しかしAIはLLMにとどまらず、NLPやGAN、そして教師なし機械学習など幅広い種類があります。そしてそれぞれに具体的なユースケース、長所、限界があります。ダークトレースはこれらについてホワイトペーパー「多層的AI装備:サイバーセキュリティを構成するツールを理解する」で詳しく解説しています 。