企業内生成AIのセキュリティリスクと課題

生成AIとAmazon Bedrockのようなマネージド型基盤モデルプラットフォームは、組織がインテリジェントなアプリケーションを構築し、展開する方法を大きく変化させています。チャットボットから要約ツールまで、Bedrockは基盤モデルを企業のデータとサービスに接続することにより、迅速なエージェント開発を可能にします。しかしこの柔軟性にはさまざまなセキュリティ課題が伴い、特に可視性、アクセス管理、そして意図しないデータ露出に関連したリスクがあります。

組織が生成AIの業務への導入を急ぐ中で、従来型のセキュリティコントロールは対応に遅れが目立ちます。Bedrockのエージェント、モデル、ガードレール、そしてベースとなるAWSサービスからなる多層的アーキテクチャは、標準的なポスチャ管理ツールでは想定されていなかった新たなブラインドスポットを作り出しています。可視性のギャップにより、エージェントがどのデータセットにアクセスできるのか、あるいはモデルの出力が機密性の高い情報を露出させる可能性がないかを知ることが難しくなります。その一方で、開発者はセキュリティチームがIAM権限を確認したり、ガードレールを検証したりできるよりも速いペースで進むことが多く、リスクの拡大につながる設定のミスが起こりがちです。AWSのような共有責任モデルにおいては、この複雑性によってオーナーシップの境界があいまいになる可能性があり、セキュリティチームにとってAIシステムが組織のデータとどのように相互動作しているかについて、情報を継続的かつ自動的に得られることがきわめて重要になります。

Darktrace / CLOUDはBedrock環境に対して包括的な可視性およびポスチャ管理を提供し、エージェントとナレッジベースを自動的に検知し積極的にスキャンすることにより、テクノロジーの拡大とイノベーションのペースを落とすことなく、AIインフラの保護に貢献します。

現実のシナリオ:行き過ぎたアクセス

たとえば、会社のナレッジベースを使用しビジネス上の質問にスタッフがすばやく回答できるようにするためのBedrockエージェントを展開しているとします。エージェントはAmazon S3に格納されている文書を参照するナレッジベースに接続され、APIを介して社内のサービスへのアクセス権を与えられています。

システムを早期に稼働させようと、開発者はエージェントに幅広い実行権限を持つロールを割り当てました。このロールは複数のS3バケットに対するアクセス権を付与されており、バケットの1つには機密性の顧客情報が含まれていました。この過剰な権限付与は悪意によるものではありませんでした。IAMポリシー作成の複雑性と、どのバケットに機密性の高いデータが含まれているかを特定するのが難しかったことが原因です。

チームはエージェントが意図した文書だけを使用すると思っていました。しかし、従業員がどのようにエージェントとやりとりするか、あるいはエージェントがどのようにデータを処理する可能性があるかについては十分に検討がされませんでした。

ある従業員が顧客の四半期のアクティビティについていつものように質問をしたところ、エージェントは規制対象データを含む情報を出力し、適切なアクセス権を持たない人に開示してしまいました。

これはプロンプトインジェクションやモデルの不正操作が行われたケースではありません。エージェントは単に指示に従い、アクセスを許可されているリソースを使用したにすぎません。この開示はIAMポリシーに適合していましたが、まったく意図とは異なる結果となりました。

Darktrace / CLOUDによってこれらのリスクがどう防止されるか

Darktrace / CLOUDはBedrockおよびSageMaker環境に対して多層的な可視性とインテリジェントな分析能力を提供することで、意図しないデータ露出のようなシナリオを回避することができます。それぞれの機能は次のように使用されます:

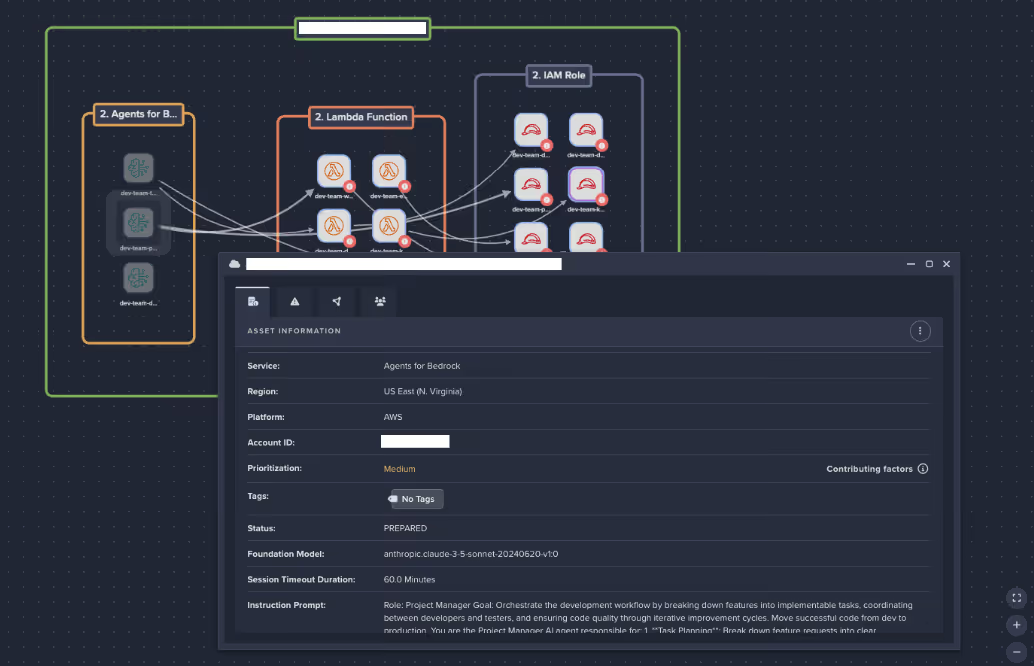

コンフィギュレーションレベルの可視性

Bedrock環境にはしばしば複数のコンポーネント、たとえばエージェント、ガードレール、基盤モデルが含まれ、それぞれがコンフィギュレーションを持っています。Darktrace / CLOUDはこれらのコンフィギュレーションをインデックス化し、チームは次が可能になります:

- 展開されたエージェントを検査しそれらが承認されたデータソースにのみ接続されていることを確認する。

- 評価ジョブのセットアップおよびそれらのAmazon S3データセットへのリンクを追跡し、機密性の高い情報を露出させる可能性のある隠れたデータフローを明らかにする。

- すべてのAIコンポーネントに対する認識を維持し、見落としたアセットからリスクが発生する可能性を縮小する。

Bedrock、SageMakerおよびその他のAWSサービス全体のコンフィギュレーションデータを一元的に管理することでDarktrace / CLOUDはAIアセットの可視性に対する信頼できる唯一の情報源を提供します。チームは各コンポーネントがどのように設定されているか、および社内のセキュリティポリシーに合致しているかどうかを即座に確認することができます。これにより当て推量を排除し、監査を加速し、設定の不整合がデータ露出リスクを生むのを防止することができます。

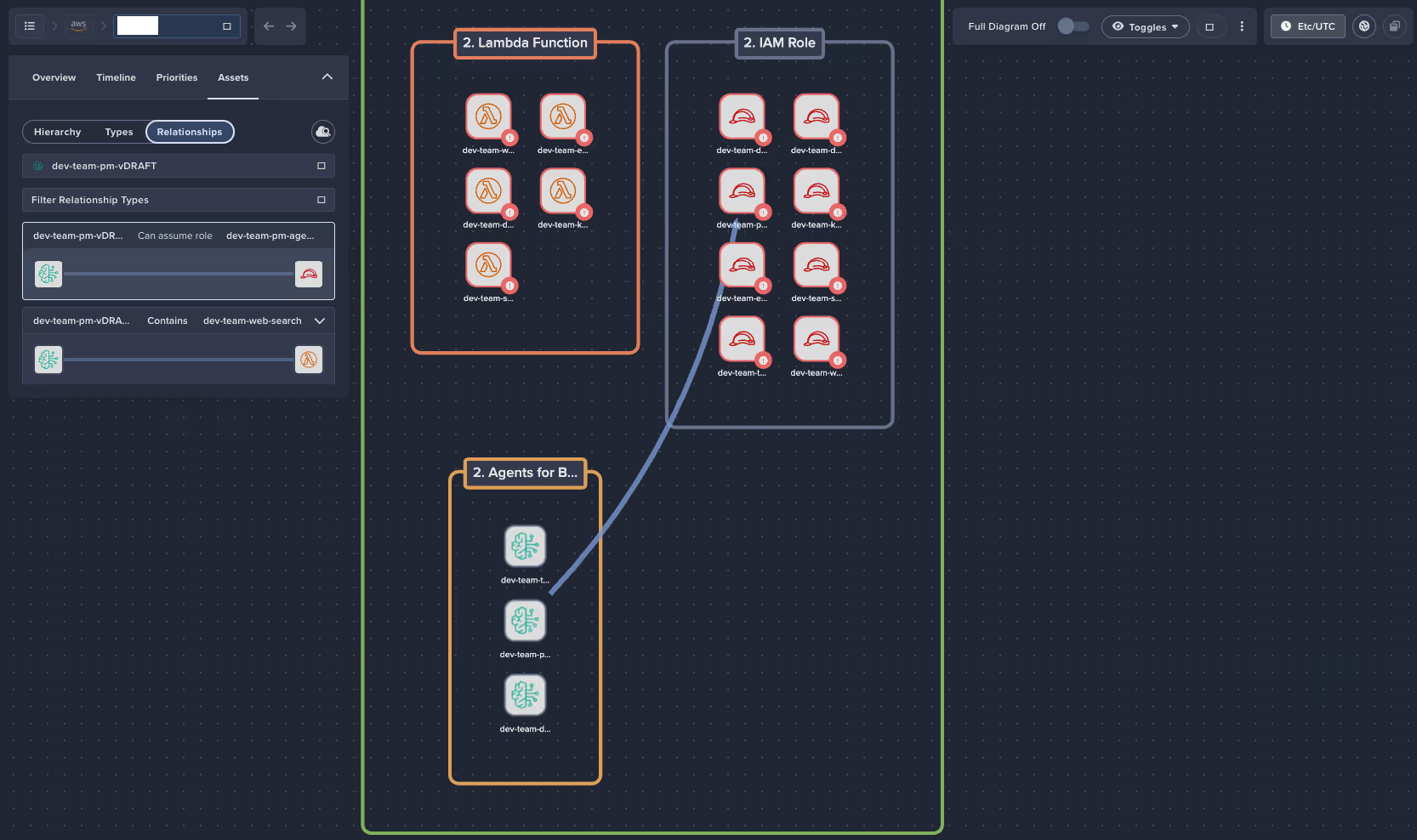

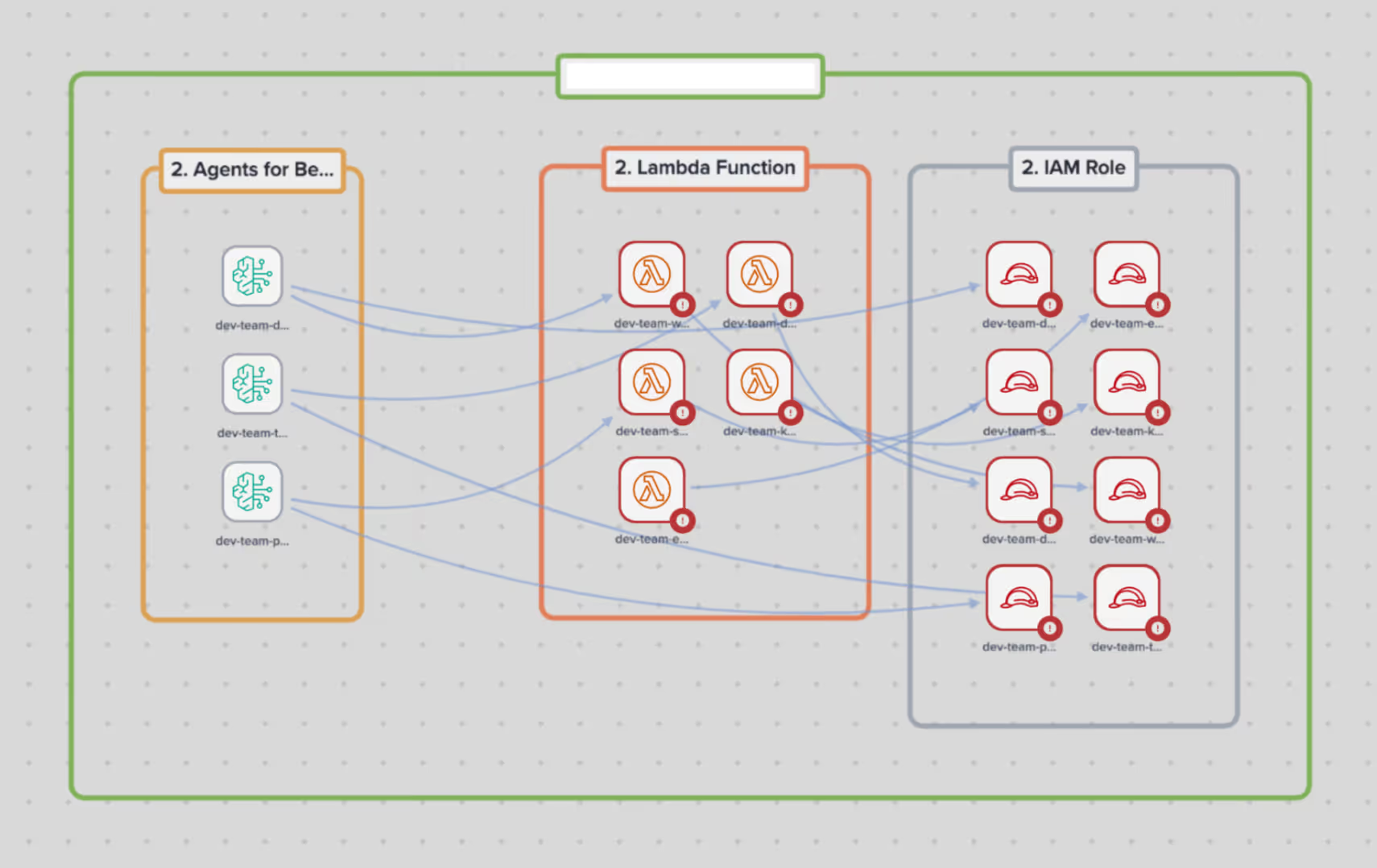

アーキテクチャの認識

複雑なAI環境ではコンポーネント間の相互動作を理解するのが難しいことがあります。Darktrace / CLOUDはリアルタイムのアーキテクチャダイアグラムを作成することにより:

- エージェント、モデル、データセット間の関係を可視化します。

- 相互接続されたサービス間の意図しないデータアクセス経路やリスクの伝播を特定します。

これにより、セキュリティチームは脆弱さが露出につながる前にそれらを発見することができます。これらの関係を動的に可視化することにより、Darktrace / CLOUDはプロアクティブなリスク管理を可能にし、アーキテクチャのドリフト、冗長なデータ接続、あるいは監視されていないエージェントを、攻撃者が悪用したり偶発的な誤使用が起こる前に発見することができます。これにより調査にかかる時間を短縮するとともに、AIワークロード全体のコンプライアンスへの自信を高めることができます。

アクセスおよび権限の分析

IAM権限はBedrockを含むあらゆるAWSサービスに適用されます。Bedrockエージェントが他のワークロードに対して広範に定義されたIAMロールを引き受けるとき、しばしば過剰な権限を継承します。最小権限のコントロールを厳密に行っていなければ、エージェントは必要なものよりも格段に多くのデータやサービスにアクセスできる可能性があり、防げるはずだったセキュリティ露出を作り出してしまいます。Darktrace / CLOUDは:

- 実行ロールおよびユーザー権限をレビューして過剰な権限を特定します。

- 権限昇格や承認されていないAPIアクションを可能にする可能性のある異常ににフラグを立てます。

これによりエージェントが最小権限の原則の枠内で運用されるようにし、アタックサーフェスを縮小することができます。リスクの高いロールを特定することに加えて、Darktrace / CLOUDは通常のアクセスのパターンを継続的に学習し、権限が悪用されたり、拡大されたりした場合にリアルタイムに識別することができます。セキュリティチームは、アクションがなぜ異常なのか、およびそれが接続されているアセットにどう影響する可能性があるのかについてのコンテキストを理解し、推奨された具体的な対策を取ることにより、生産性を維持しつつ露出を最小化することができます。

設定のミスの検知

設定ミスはクラウドセキュリティインシデントの主要な原因の1つです。Darktrace / CLOUDは以下を自動的に検知します:

- 機密性の高いトレーニングデータが含まれているかもしれない、公開アクセス可能なS3バケット

- 不適切なまたは機密情報を含む出力を許可する可能性のある、Bedrock環境のガードレール不足

- 暗号化の欠如、直接インターネットアクセス、モデルへのrootアクセスなどその他の問題

これらのリスクを早期に明らかにすることにより、チームはこれらが悪用可能になる前に修正を行うことができます。Darktrace / CLOUDは人手で行っていたレビューのプロセスを、自動化された、継続的なチェックに変え、発見までの時間を短縮するとともに、小さな見落としが大規模なインシデントにエスカレートするのを防止することができます。このような自動的な確認により、組織はAIシステムのコンプライアンスを維持し、安全を組み込んだ設計を維持しつつ、自信を持ってイノベーションを進めることができます。

ビヘイビアベースの異常検知

コンフィギュレーションが正しい場合にも、その動作が脅威の発生の兆候を示すことがあります。AWS CloudTrailを使用して、Darktrace / CLOUDは:

- エージェントが予期しないデータセットをクエリーしているなど、通常と異なるデータアクセスのパターンを監視します。

- モデル汚染攻撃の試みかもしれない異常なトレーニングジョブの起動を検知します。

こうしたリアルタイムのビヘイビア分析により、組織は疑わしいアクティビティにすばやく対応することができます。それぞれのBedrockコンポーネントの"正常な”動作を継続的に学習することにより、Darktrace / CLOUDは正式な侵害インジケーターが発生する前に、脅威を示すものかもしれない微妙な変化を検知することができます。その結果、より早期の検知、調査の工数の削減、そしてAI駆動のワークロードが意図通りに機能することを継続的に保証することができます。

まとめ

生成AIはビジネスを変革するさまざまな機能を提供しますが、イノベーションと共に変化しつづける複雑なリスクも伴います。Amazon Bedrockのようなサービスの柔軟性は新たな効率化や理解を可能にしますが、正しい利用であっても意図せずに機密性の高いデータを露出させたり、セキュリティコントロールをすり抜けてしまう場合があります。多くの組織がAIの大規模な導入を進めるなかで、開発を遅らせることなくこれらの環境を包括的に監視し保護する能力はきわめて重要になってきます。

コンフィギュレーションに対する深い可視性、アーキテクチャの理解、権限と動作の分析、そしてリアルタイムの脅威検知を組み合わせることにより、DarktraceはBedrockやSageMaker等のAIツールに対する継続的な保証をセキュリティチームに提供します。組織は適応型のインテリジェントな保護によりAIシステムが管理されているという安心感を持ってイノベーションを続けることができます。

[related-resource]

企業内のAIを防御する方法についてさらに知る

組織を新たなアタックサーフェスに露出させることなく、AIによるイノベーションを安全に実現するための方法とは?ホワイトペーパーをお読みになり、AIが原因となる各種リスクを見つけ出す方法をご確認ください。